سرورهای هوش مصنوعی Nvidia در لبه (Edge AI)

مقدمه

با گسترش کاربردهای هوش مصنوعی در صنایع مختلف، نیاز به پردازش دادهها در نزدیکترین نقطه به منبع تولید داده بیش از پیش احساس میشود. این رویکرد که با عنوان Edge AI شناخته میشود، به معنای اجرای مدلهای هوش مصنوعی در لبه شبکه و خارج از مراکز داده متمرکز است. شرکت Nvidia با توسعه سرورها و پلتفرمهای سختافزاری و نرمافزاری ویژه، نقش مهمی در تحقق Edge AI ایفا کرده و امکان اجرای مدلهای پیشرفته یادگیری ماشین و یادگیری عمیق را در محیطهای محدود از نظر توان، فضا و تأخیر فراهم ساخته است.

مفهوم Edge AI و ضرورت آن

در معماریهای سنتی، دادهها از طریق شبکه به مراکز داده مرکزی ارسال و پس از پردازش، نتایج به دستگاهها بازگردانده میشوند. این مدل در بسیاری از کاربردها با چالشهایی مانند تأخیر بالا، مصرف زیاد پهنای باند، هزینههای انتقال داده و ملاحظات امنیتی مواجه است. Edge AI با انتقال پردازش به لبه شبکه، مزایای زیر را فراهم میکند:

- کاهش محسوس تأخیر (Latency)

- افزایش قابلیت اطمینان در شرایط قطع یا محدودیت ارتباط شبکه

- کاهش حجم داده ارسالی به مراکز داده

- بهبود امنیت و حریم خصوصی دادهها

این مزایا Edge AI را به گزینهای کلیدی برای کاربردهای بلادرنگ و حیاتی تبدیل کرده است.

نقش Nvidia در توسعه زیرساخت Edge AI

Nvidia با درک نیازهای خاص پردازش در لبه، پلتفرمهایی را توسعه داده که ترکیبی از GPUهای کممصرف اما قدرتمند، شتابدهندههای اختصاصی AI و اکوسیستم نرمافزاری یکپارچه هستند. برخلاف سرورهای دیتاسنتری کلاسیک، سرورهای Edge AI باید بتوانند در محیطهای صنعتی، شرایط دمایی متغیر و محدودیتهای انرژی بهصورت پایدار عمل کنند.

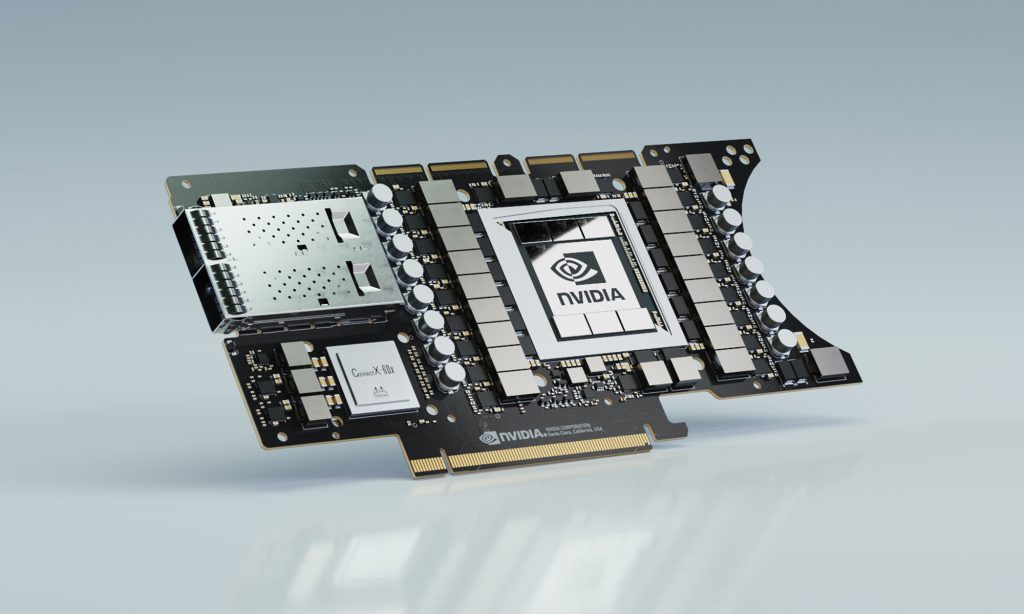

معماری سرورهای Edge AI مبتنی بر Nvidia

سرورهای هوش مصنوعی Nvidia در لبه معمولاً بر پایه پلتفرمهایی مانند Nvidia Jetson، Nvidia EGX و GPUهای سری L4 یا A2 طراحی میشوند. این معماریها ویژگیهای زیر را ارائه میدهند:

- توان پردازشی مناسب برای استنتاج (Inference) مدلهای عمیق

- مصرف انرژی بهینه نسبت به GPUهای دیتاسنتری

- پشتیبانی از شتابدهی سختافزاری برای بینایی ماشین و پردازش ویدئو

- امکان استقرار در رکهای کوچک یا حتی محیطهای بدون رک

پلتفرم EGX بهطور خاص برای یکپارچهسازی GPU، شبکه و نرمافزار در محیطهای Edge طراحی شده و پلی بین مراکز داده و لبه شبکه محسوب میشود.

تفاوت سرورهای Edge AI با سرورهای دیتاسنتری

سرورهای Edge AI تفاوتهای بنیادینی با سرورهای سنتی مراکز داده دارند:

- هدف پردازشی: تمرکز اصلی بر استنتاج بلادرنگ بهجای آموزش مدل

- مصرف انرژی: بهینهسازیشده برای توان پایین

- ابعاد و استقرار: مناسب برای محیطهای محدود مانند کارخانهها، فروشگاهها و ایستگاههای مخابراتی

- تابآوری محیطی: طراحیشده برای شرایط صنعتی و عملیاتی خاص

در مقابل، سرورهای دیتاسنتری بیشتر برای آموزش مدلهای بزرگ و پردازشهای سنگین دستهای بهکار میروند.

کاربردهای کلیدی Edge AI با سرورهای Nvidia

سرورهای Edge AI مبتنی بر Nvidia در طیف گستردهای از صنایع مورد استفاده قرار میگیرند:

-

بینایی ماشین و پردازش ویدئو

تحلیل ویدئوی بلادرنگ در دوربینهای نظارتی، مدیریت ترافیک و تشخیص رفتارهای غیرعادی

-

صنعت و تولید هوشمند

کنترل کیفیت خودکار، پیشبینی خرابی تجهیزات و بهینهسازی خطوط تولید

-

خودروهای خودران و حملونقل هوشمند

پردازش دادههای سنسورها و تصمیمگیری بلادرنگ بدون وابستگی کامل به ابر

-

سلامت و تجهیزات پزشکی

تحلیل دادههای تصویربرداری و پایش لحظهای بیماران در محل

-

خردهفروشی هوشمند

تحلیل رفتار مشتری، مدیریت موجودی و بهینهسازی تجربه خرید

نقش نرمافزار و پلتفرمهای Nvidia در Edge AI

موفقیت Edge AI تنها به سختافزار وابسته نیست. Nvidia با ارائه پلتفرمهایی مانند Nvidia JetPack، DeepStream، TensorRT و CUDA امکان بهینهسازی و استقرار آسان مدلهای هوش مصنوعی را در لبه فراهم کرده است. این ابزارها به توسعهدهندگان اجازه میدهند:

- مدلهای آموزشدیده در دیتاسنتر را برای اجرا در Edge بهینهسازی کنند

- زمان پاسخدهی را کاهش دهند

- مصرف انرژی و منابع را مدیریت کنند

همچنین پشتیبانی از کانتینرها و Kubernetes در پلتفرمهای Edge Nvidia، مدیریت مقیاسپذیر این سرورها را سادهتر میکند.

چالشها و ملاحظات پیادهسازی

با وجود مزایای قابلتوجه، پیادهسازی Edge AI با چالشهایی همراه است:

- محدودیت منابع محاسباتی نسبت به دیتاسنتر

- نیاز به مدیریت و بهروزرسانی تعداد زیادی نود Edge

- ملاحظات امنیتی در محیطهای غیرمتمرکز

Nvidia با ارائه راهکارهای مدیریت، امنیت سختافزاری و نرمافزاری و پشتیبانی طولانیمدت، بخشی از این چالشها را پوشش داده است.

جمعبندی

سرورهای هوش مصنوعی Nvidia در لبه شبکه، نقش کلیدی در گسترش کاربردهای بلادرنگ و هوشمند در صنایع مختلف دارند. این سرورها با تمرکز بر استنتاج سریع، مصرف انرژی بهینه و یکپارچگی نرمافزاری، امکان انتقال قدرت هوش مصنوعی از مراکز داده به نزدیکترین نقطه به منبع داده را فراهم میکنند. Edge AI نهتنها مکمل معماریهای مبتنی بر ابر است، بلکه در بسیاری از سناریوها به یک الزام عملیاتی تبدیل شده و Nvidia یکی از بازیگران اصلی این تحول محسوب میشود.

تیم فنی شرکت کوشا فناوران مبتکر ، با ترکیب تجربه و تخصص فناوری نوین، آماده خدمت گذاری به سازمانها و نهادهای دولتی و خصوصی در حوزه ایجاد و پیاده سازی زیرساخت های شبکه و امنیت سایبری از جمله زیرساخت پشتیبانگیری و بازیابی اطلاعات می باشد.

جهت مطالعه مقالات بیشتر به بخش مطالب آموزشی سایت www.tapestorage.net و مجله مبتکر به آدرس https://blog.tapestorage.ir مراجعه فرمائید .

این موضوع چقدر برای شما مفید بود؟

روی یک ستاره کلیک کنید تا به آن امتیاز دهید!

میانگین امتیاز 4.9 / 5. امتیاز: 54

تا الان امتیازی ثبت نشده! اولین نفری باشید که به این پست امتیاز می دهید.