مقیاسپذیری شبکههای عصبی بزرگ با Nvidia DGX و HGX

مقدمه

رشد سریع مدلهای یادگیری عمیق، بهویژه شبکههای عصبی عمیق و مدلهای زبانی بزرگ (Large Language Models)، نیاز به زیرساختهای محاسباتی با توان پردازشی بسیار بالا و قابلیت مقیاسپذیری افقی و عمودی را به یک ضرورت تبدیل کرده است. در این میان، شرکت Nvidia با ارائه پلتفرمهای DGX و HGX نقش کلیدی در توسعه و عملیاتیسازی زیرساختهای هوش مصنوعی در مقیاس مراکز داده ایفا میکند. این پلتفرمها بهطور خاص برای پاسخگویی به چالشهای آموزش و استنتاج مدلهای بسیار بزرگ طراحی شدهاند و ترکیبی از سختافزار پیشرفته، ارتباطات پرسرعت و اکوسیستم نرمافزاری بهینه را ارائه میدهند.

مفهوم مقیاسپذیری در شبکههای عصبی بزرگ

مقیاسپذیری در حوزه هوش مصنوعی به توانایی افزایش منابع محاسباتی برای کاهش زمان آموزش، افزایش اندازه مدل یا پردازش حجم بیشتری از داده اشاره دارد. این مقیاسپذیری میتواند به دو شکل اصلی انجام شود:

- مقیاسپذیری عمودی (Scale-Up): استفاده از GPUهای قدرتمندتر و افزایش حافظه و پهنای باند در یک نود واحد

- مقیاسپذیری افقی (Scale-Out): توزیع بار محاسباتی بین چندین نود و سرور

پلتفرمهای DGX و HGX هر دو برای پشتیبانی همزمان از این دو رویکرد طراحی شدهاند و امکان اجرای کارآمد مدلهایی با میلیاردها پارامتر را فراهم میکنند.

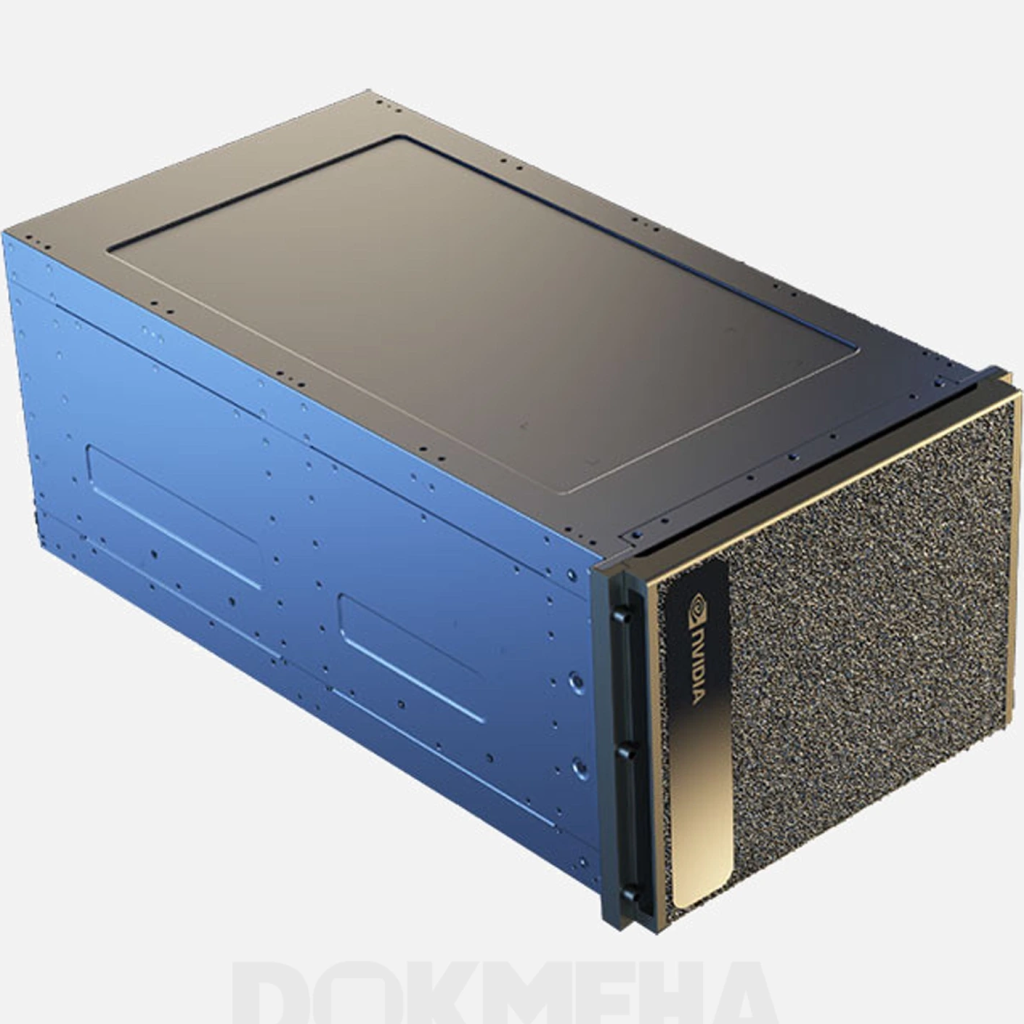

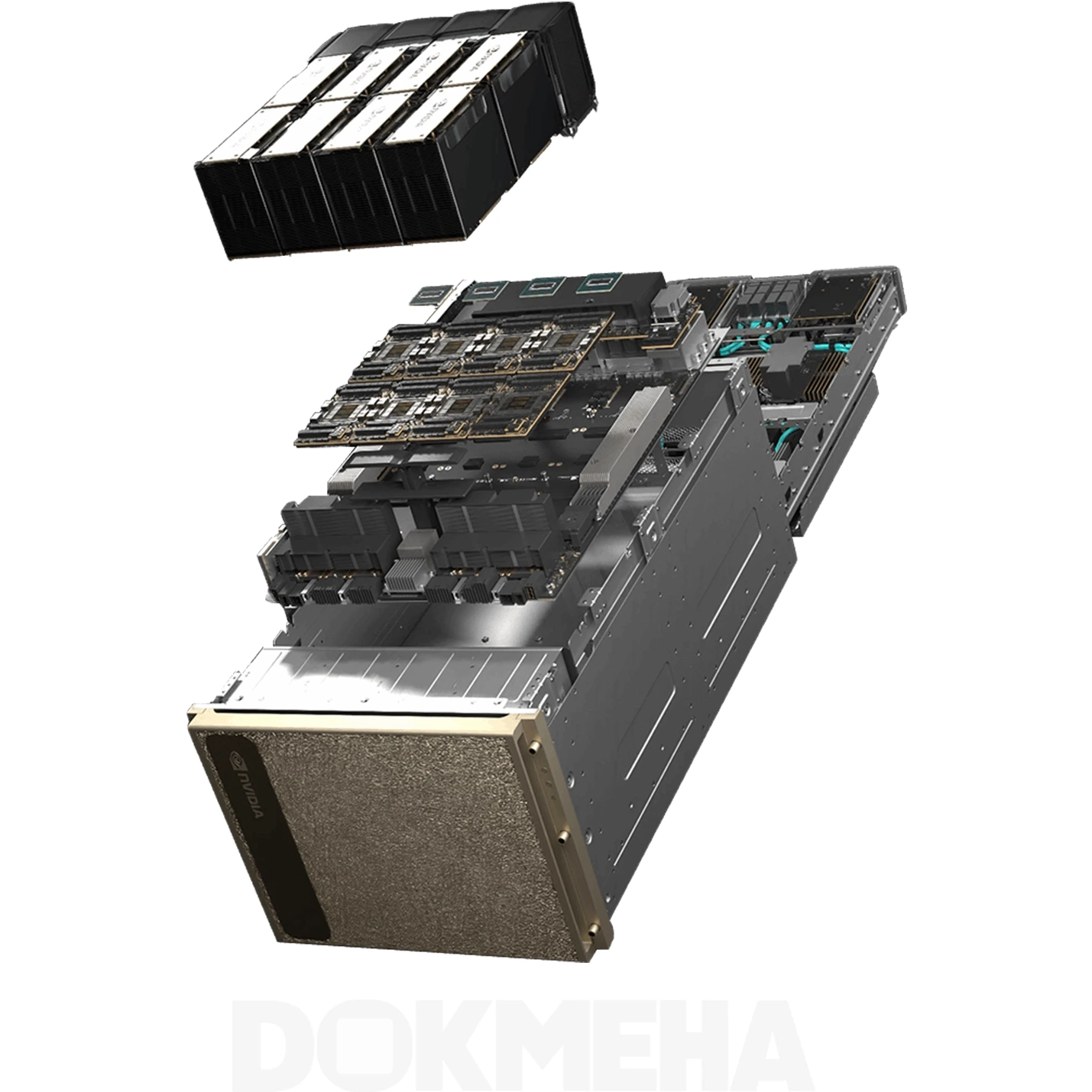

معماری Nvidia DGX

پلتفرم Nvidia DGX بهعنوان یک راهکار یکپارچه (Turnkey Solution) برای هوش مصنوعی ارائه شده است. سرورهای DGX شامل مجموعهای از GPUهای دیتاسنتری Nvidia (مانند A100، H100 یا H200)، پردازندههای مرکزی قدرتمند، حافظه پرسرعت و شبکه داخلی مبتنی بر NVLink هستند.

ویژگیهای کلیدی DGX عبارتاند از:

- اتصال GPUها از طریق NVLink با پهنای باند بسیار بالا

- پیکربندی بهینهشده برای آموزش مدلهای عمیق

- ارائه همراه با نرمافزارهای Nvidia AI Enterprise و پشتیبانی رسمی

- کاهش پیچیدگی پیادهسازی زیرساخت AI در سازمانها

DGX بیشتر مناسب سازمانها و تیمهایی است که به دنبال راهکاری آماده، پایدار و با حداقل زمان راهاندازی هستند.

معماری Nvidia HGX

در مقابل، Nvidia HGX یک پلتفرم ماژولار در سطح برد و شاسی است که به تولیدکنندگان سرور (OEMها) اجازه میدهد راهکارهای سفارشیسازیشده برای هوش مصنوعی طراحی کنند. HGX معمولاً شامل ۴ یا ۸ GPU است که از طریق NVLink یا NVSwitch به یکدیگر متصل میشوند.

مزایای اصلی HGX شامل موارد زیر است:

- انعطافپذیری بالا در طراحی سرور و مراکز داده

- امکان استفاده در کلاسترهای بزرگ و سفارشی

- پشتیبانی از توپولوژیهای پیچیده ارتباطی برای مقیاسپذیری افقی

- سازگاری با شبکههای پرسرعت مانند InfiniBand

HGX بیشتر در محیطهایی استفاده میشود که نیاز به کنترل کامل بر معماری سختافزار و شبکه وجود دارد، مانند مراکز داده hyperscale و ارائهدهندگان سرویسهای ابری.

نقش NVLink و NVSwitch در مقیاسپذیری

یکی از عوامل کلیدی در مقیاسپذیری شبکههای عصبی بزرگ، ارتباط پرسرعت بین GPUها است. فناوریهای NVLink و NVSwitch این امکان را فراهم میکنند که GPUها حافظه یکدیگر را با latency بسیار کم و پهنای باند بالا به اشتراک بگذارند.

در آموزش مدلهای بزرگ، حجم زیادی از داده و پارامترها بین GPUها ردوبدل میشود. استفاده از NVLink باعث میشود:

- سربار ارتباطی کاهش یابد

- کارایی موازیسازی داده (Data Parallelism) و مدل (Model Parallelism) افزایش یابد

- مقیاسپذیری تا دهها یا صدها GPU با افت عملکرد حداقلی امکانپذیر شود

DGX در مقابل HGX: مقایسه کاربردی

اگرچه هر دو پلتفرم برای هوش مصنوعی طراحی شدهاند، اما رویکرد متفاوتی دارند:

- DGX: راهکار آماده، سادهتر برای پیادهسازی، مناسب سازمانهایی با تیم IT محدود

- HGX: انعطافپذیر، قابل سفارشیسازی، مناسب محیطهای ابری و مقیاس بسیار بزرگ

از نظر عملکرد خام، تفاوت چندانی وجود ندارد، اما انتخاب بین این دو بیشتر به استراتژی زیرساخت، سطح تخصص فنی و نیازهای عملیاتی بستگی دارد.

نقش اکوسیستم نرمافزاری Nvidia

سختافزار بهتنهایی تضمینکننده مقیاسپذیری نیست. Nvidia با ارائه ابزارهایی مانند CUDA، NCCL، cuDNN و چارچوبهای توزیعشده برای PyTorch و TensorFlow، امکان استفاده بهینه از DGX و HGX را فراهم کرده است. این ابزارها فرآیند توزیع بار محاسباتی، همگامسازی پارامترها و مدیریت حافظه را بهصورت شفاف و کارآمد انجام میدهند.

جمعبندی

مقیاسپذیری شبکههای عصبی بزرگ بدون زیرساخت مناسب عملاً غیرممکن است. پلتفرمهای Nvidia DGX و HGX با ترکیب GPUهای قدرتمند، ارتباطات پرسرعت و اکوسیستم نرمافزاری بالغ، ستون فقرات بسیاری از پروژههای هوش مصنوعی در سطح سازمانی و مراکز داده مدرن را تشکیل میدهند. انتخاب بین DGX و HGX باید بر اساس نیازهای عملیاتی، سطح سفارشیسازی و چشمانداز رشد سازمان انجام شود، اما در هر دو حالت، این پلتفرمها مسیر توسعه هوش مصنوعی در مقیاس بزرگ را هموار میکنند.

تیم فنی شرکت کوشا فناوران مبتکر ، با ترکیب تجربه و تخصص فناوری نوین، آماده خدمت گذاری به سازمانها و نهادهای دولتی و خصوصی در حوزه ایجاد و پیاده سازی زیرساخت های شبکه و امنیت سایبری از جمله زیرساخت پشتیبانگیری و بازیابی اطلاعات می باشد.

جهت مطالعه مقالات بیشتر به بخش مطالب آموزشی سایت www.tapestorage.net و مجله مبتکر به آدرس https://blog.tapestorage.ir مراجعه فرمائید .

این موضوع چقدر برای شما مفید بود؟

روی یک ستاره کلیک کنید تا به آن امتیاز دهید!

میانگین امتیاز 4.9 / 5. امتیاز: 358

تا الان امتیازی ثبت نشده! اولین نفری باشید که به این پست امتیاز می دهید.